Un phénomène inquiétant progresse dans les collèges et lycées français.

À partir d’une simple photo récupérée sur Instagram ou Snapchat, des outils d’intelligence artificielle permettent de “déshabiller” virtuellement des adolescentes (ou des adolescents), sans leur consentement. En quelques secondes. Gratuitement. Et sans compétence technique.

Ces images sont fausses. Mais la violence, elle, est bien réelle.

Honte, peur, silence, isolement… Les victimes sont souvent mineures. Les auteurs parfois aussi. Et les parents découvrent le problème trop tard, quand les dégâts psychologiques sont déjà là.

👉 Cet article a un objectif clair : vous aider à comprendre ce phénomène, à mesurer sa gravité, et surtout à agir concrètement pour protéger vos enfants.

Deepnude : de quoi parle-t-on exactement ?

Le deepnude ou deepfake porno désigne des images ou des vidéos à caractère sexuel créées artificiellement par intelligence artificielle, à partir du visage ou du corps d’une personne réelle – sans son consentement.

Concrètement, le mécanisme est glaçant de simplicité.

Une photo suffit. Un selfie, une image de profil Instagram, une story Snapchat, parfois même une photo de classe récupérée en ligne. Ces images sont ensuite traitées par des outils d’IA capables de “déshabiller” virtuellement une personne, ou de l’intégrer dans une scène sexuelle hyperréaliste.

Aucune compétence technique n’est nécessaire.

Ces outils sont accessibles en quelques clics, gratuitement ou pour quelques euros, souvent hébergés à l’étranger. En quelques secondes, l’image est générée.

👉 Le point clé à comprendre : ces images sont fausses, mais elles paraissent réelles.

C’est précisément ce réalisme qui rend le deepnude si destructeur. Pour un regard extérieur — camarades de classe, enseignants, inconnus sur Internet – il devient presque impossible de distinguer le vrai du faux. Et pour la victime, le choc est immense.

Contrairement à ce que certains imaginent, il ne s’agit ni :

- d’un simple photomontage “à l’ancienne”,

- ni d’une “blague”,

- ni d’un jeu entre adolescents.

Le deepnude est une agression sexuelle numérique.

Il peut être utilisé pour humilier, harceler, se venger, faire pression, ou faire chanter. Et lorsqu’il vise des mineures, il bascule dans un champ pénal extrêmement grave.

Autre idée reçue à déconstruire :

“Mais si la photo est fausse, ce n’est pas si grave.”

C’est faux !

Le traumatisme ne vient pas de la véracité de l’image, mais de sa diffusion, de la perte de contrôle, et du regard des autres. Le cerveau, lui, ne fait pas la différence entre une image réelle et une image générée par IA lorsqu’elle est perçue comme crédible.

Enfin, il est important de le dire clairement aux parents comme aux adolescents :

👉 Même s’il n’existe aucune photo intime réelle à l’origine, créer ou partager un deepfake porno est strictement illégal, et lourdement puni par la loi.

Comprendre ce qu’est réellement le deepfake porno, c’est la première étape pour sortir du déni – et commencer à protéger efficacement nos enfants.

Pourquoi le deepnude cible les adolescentes ?

Si le deepnude progresse aussi vite, ce n’est pas un hasard. Et si les adolescentes en sont les premières victimes, ce n’est ni parce qu’elles seraient “imprudentes”, ni parce qu’elles feraient “n’importe quoi” en ligne. C’est parce qu’elles se trouvent au croisement parfait de plusieurs vulnérabilités numériques.

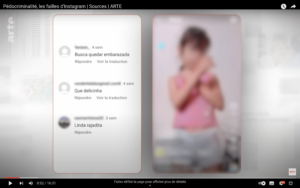

Comme l’a montré une enquête récente de Le Monde, les cas se multiplient dans les collèges et lycées français. Des jeunes filles parfois âgées de 12, 13 ou 14 ans découvrent leur visage intégré à des images sexuelles générées par l’IA, diffusées sur Instagram, Snapchat ou dans des groupes privés. Le phénomène n’est plus marginal : il s’installe.

La première raison est simple : les adolescentes sont très exposées en ligne.

À l’adolescence, les réseaux sociaux occupent une place centrale : photos de profil, selfies, stories, vidéos du quotidien. Ces images sont souvent accessibles, parfois publiques, parfois récupérées via des comptes privés. Pour les outils de deepfake porno, un simple visage suffit. Il n’est pas nécessaire qu’il existe la moindre image intime à l’origine.

Deuxième raison : la sexualisation précoce et persistante des jeunes filles dans l’espace numérique.

Très tôt, leur apparence est commentée, évaluée, jugée. Cette pression constante crée un terrain favorable aux dérives : le deepfake porno ne fait qu’exploiter et amplifier une culture déjà problématique, en la transformant en violence ciblée.

Un autre élément important est la proximité entre victimes et auteurs.

Dans de nombreux cas, les contenus ne sont pas créés par des inconnus, mais par des personnes de l’entourage scolaire ou social : camarades, connaissances, parfois légèrement plus âgés. L’outil technologique devient alors un moyen de nuire, d’humilier ou de faire pression, souvent dans des contextes de conflit, de rejet ou de frustration.

À cela s’ajoute une banalisation inquiétante de l’acte chez certains jeunes.

Parce que l’image est générée par une machine, certains minimisent la gravité du geste : “ce n’est pas réel”, “ce n’est qu’un montage”. Cette distance artificielle efface la conscience des conséquences pour la personne visée et favorise des comportements qui seraient impensables autrement.

Deepnude : ce que dit la loi (et ce que beaucoup ignorent)

Sur ce point, il n’y a aucune zone grise.

Le deepfake porno visant des adolescentes est strictement illégal en France – et lourdement puni. Pourtant, cette réalité reste largement méconnue, y compris chez les parents… et chez certains jeunes.

D’abord, un principe fondamental à rappeler clairement :

👉 Une image sexuelle impliquant un mineur est illégale, même si elle est entièrement générée par l’intelligence artificielle.

Il n’est pas nécessaire qu’une photo intime “réelle” existe à l’origine. Le simple fait de créer ou de diffuser un contenu sexuel artificiel représentant un mineur constitue une infraction pénale grave.

La loi assimile ces contenus à de la pornographie de mineurs ou à des deepfakes sexuels non consentis, deux catégories sévèrement sanctionnées.

Concrètement, cela signifie que :

- générer une image sexuelle par IA à partir du visage d’une mineure,

- partager ce contenu, même dans un groupe privé,

- ou le diffuser sur un réseau social, une messagerie ou un site

expose son auteur — mineur ou majeur — à des poursuites pénales.

Les peines encourues sont lourdes :

- jusqu’à plusieurs années de prison,

- des dizaines de milliers d’euros d’amende,

- avec des peines aggravées lorsque les faits sont commis en ligne ou concernent des mineurs.

Un autre point souvent ignoré :

👉 Dire “c’était une blague” ou “ce n’était pas réel” n’a aucune valeur juridique.

L’intention humoristique, l’usage d’une IA ou le caractère fictif de l’image ne constituent pas des excuses. Ce qui compte, ce sont :

- l’atteinte à la dignité de la victime,

- l’absence de consentement,

- et la diffusion du contenu.

La loi vise également les diffuseurs, pas seulement les créateurs.

Relayer, repartager ou conserver ce type de contenu peut suffire à engager une responsabilité pénale.

Enfin, il faut être lucide : si le cadre légal existe, les enquêtes restent complexes. Identifier les auteurs, prouver la diffusion et agir rapidement n’est pas toujours simple. Cela explique pourquoi certaines plaintes n’aboutissent pas – mais cela ne rend jamais l’acte légal ou anodin.

Ce que beaucoup ignorent encore, c’est ceci :

👉 le deepfake porno n’est pas un dérapage technologique, c’est un délit.

Et lorsqu’il vise des adolescentes, il relève des formes les plus graves de violence numérique.

Comprendre la loi, c’est une étape essentielle pour :

- protéger les victimes,

- responsabiliser les auteurs,

- et rappeler un message clair aux jeunes : l’IA ne vous met pas au-dessus des règles.

Comment protéger concrètement son enfant face au deepfake porno

Il n’existe pas de solution miracle ni de risque zéro.

Mais face au deepfake porno, les parents disposent de leviers simples, concrets et efficaces pour réduire fortement l’exposition de leurs enfants et surtout pour leur permettre de réagir s’ils sont confrontés au problème.

La protection commence bien avant l’incident.

1. Ouvrir la discussion – tôt, clairement, sans dramatiser

C’est le point le plus important.

Un adolescent informé est un adolescent mieux protégé.

- Expliquez simplement ce qu’est un deepfake porno, sans entrer dans des détails inutiles.

- Rappelez une règle essentielle : personne n’a le droit d’utiliser son image sans son accord, encore moins à des fins sexuelles.

- Insistez sur un message clé : s’il arrive quelque chose, vous serez cru et soutenu.

👉 Un ado qui sait qu’il peut parler sans être jugé parlera plus vite.

2. Réduire l’exposition des images (sans interdire les réseaux sociaux)

Il ne s’agit pas de supprimer les réseaux, mais de limiter les risques.

Actions concrètes :

- Passer les comptes en mode privé.

- Vérifier régulièrement qui peut voir, commenter ou partager les photos.

- Éviter les photos trop identifiables (uniforme scolaire visible, nom de l’établissement, lieux précis).

- Sensibiliser à la republication : une photo postée par un ami est aussi une photo “hors de contrôle”.

👉 Moins une image circule, moins elle peut être détournée.

3. Apprendre à son ado à reconnaître les signaux d’alerte

Les victimes ne disent pas toujours “il m’est arrivé quelque chose”.

Elles changent de comportement.

Soyez attentif à :

- un repli soudain,

- une anxiété inhabituelle liée au téléphone,

- un refus d’aller à l’école,

- des crises de larmes ou de colère inexpliquées,

- une peur excessive du regard des autres.

👉 Ces signaux ne prouvent rien, mais ils doivent toujours déclencher une discussion.

4. Rappeler des règles claires… aussi pour les autres

Protéger son enfant, c’est aussi lui apprendre ce qu’il n’a pas le droit de faire.

- Créer, partager ou “juste regarder” un deepfake porno est illégal.

- Participer à un groupe où ces images circulent engage une responsabilité.

- “Ce n’est pas réel” n’est jamais une excuse.

👉 Ce discours protège à la fois votre ado et les autres.

5. Préparer un plan d’action en cas de problème

Quand un incident survient, le temps est un facteur clé.

À anticiper ensemble :

- Conserver les preuves (captures d’écran, liens, pseudos).

- Ne pas répondre aux provocations ou au chantage.

- Signaler immédiatement le contenu sur la plateforme concernée.

- Savoir à qui s’adresser pour être aidé rapidement (parents, établissement scolaire, services spécialisés).

👉 Avoir un plan réduit la panique et redonne du contrôle à l’adolescent.

6. Privilégier l’éducation plutôt que la surveillance

Le contrôle permanent est rarement efficace.

La compréhension, beaucoup plus.

- Parlez d’image, de consentement, de respect.

- Expliquez que le numérique a une mémoire longue.

- Rappelez que demander de l’aide n’est jamais une faiblesse.

👉 Un adolescent formé est bien plus protégé qu’un adolescent surveillé.

À retenir

Vous ne pouvez pas tout empêcher.

Mais vous pouvez :

- informer,

- réduire les risques,

- repérer les signaux faibles,

- et surtout créer un cadre de confiance.

Face au deepfake porno, le meilleur bouclier reste un adulte présent, informé et à l’écoute.